无论是业界顶尖的 Perplexity 还是各类开源企业级知识问答助手,其核心基座无一例外都是 RAG(Retrieval-Augmented Generation,检索增强生成) 架构。

如果在概念认知上只停留于“把长文档复制给大模型让它读”,那么你在真实业务调优时往往会对检索出的狗屁不通的内容一筹莫展。 真正的 RAG 是一套精密严谨的数据工程(Data Engineering)管线系统,它由五个极其硬核的技术节点串联而成。我们通过**“智能图书馆自动化归档与查阅”**的白话类比,来将其剖析得清清楚楚。

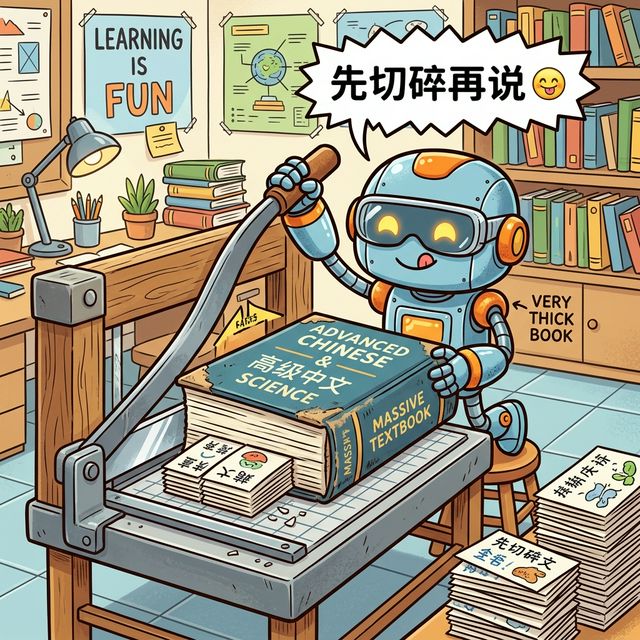

🔪 1. 结构化切分:Chunking(语料块切割)

技术原理: LLM(大语言模型)不仅存在着硬性的上下文窗口长度限制(Context Window Limit),且对被检索出的大段冗余废话容忍度极差。因此当面对数十 M 的 PDF 或者工程代码库入库时,首班车必须驶入数据清洗站进行拆解。开发人员需选用合适的解析器策略(如靠标点符号切分,或基于语义段落切分 Token 数量)生成长度从 200 到 1000 Tokens 不等的块(Chunks)。

大白话比喻: 第一步是用“精细的碎纸机”把厚达 1000 页的公司死板财报书切成一张张小卡片(每张卡片刚好讲完一个报销小知识点)。切得太细,卡片上的字没头没尾全断层了;段落切得太大,模型最后看不过来。

🔢 2. 知识高维映射:Embedding 向量化建档入图

技术原理: 切出的原始文本对机器检索算法来说无法比对“相似性”。我们调用专用的稠密向量特征表征模型(Embedding Models,如 text-embedding-ada-002),将上述每个 Chunk 独立转化为高维度(例如 1536 维)の浮点数数组坐标系统集。赋予知识片段坐标的同时挂载上对应来源链接并最终装载锁定在硬盘里。

大白话比喻:

切好知识卡片后,由于图书管理员不懂中文,机器会给每一张卡片打上一串代表了“灵魂意思”的极其神秘的条形码数组标签(比如 [0.12, -0.4, ...])。这组带有立体坐标系距离概念的标签,方便稍后的精确雷达搜寻扫射。

🔦 3. 全局搜索网获:Retrieval(粗排初筛与混合向量检索)

技术原理: 当来自云端的用户扔来一条自然语言的疑问(Query)长句时,系统对这句话再次通过同样的 Embedding 转化成特征浮点坐标。它拿着该向量扔入 云端库(Vector Database) 执行近邻近似搜查(比如 KNN 计算余弦相似度距离运算)。此外,在高端企业部署中往往会辅以经典的关键字反向匹配系统(BM25 或 Elasticsearch)组成**混合检索策略(Hybrid Search)**最大规模广撒网兜回上百个候选段。

大白话比喻: 一旦顾客在问询台发难:“出差打车怎么报销?” 。电脑也用转换机器把顾客问题换成星际坐标编码卡,然后跑到地下档案库里广发通缉令,瞬间用雷达倒腾出来了 20 张和“报销”、“打车”坐标长得最近的首飞搜索结果。

🧐 4. 交叉验证裁决:Reranking(精排降噪)

技术原理: 上面“只看坐标距离粗排”直接抽回的 20 个段落里往往混杂了“打死车里的老鼠”这种与打车毫无语义关切的垃圾数据。直接打包塞给 LLM 会发生严重的噪音致幻效果。因此,我们让 Cross-Encoder 类打分专用小模型(Reranker)将用户 Query 加上被抽出的这段语料再次串在一起仔细通读、重新进行严格的概率相关度评分(Sort Rank)。

大白话比喻: 系统请出一位严厉的审查老教授,拿着一沓 20 张粗糙初筛可疑的卡片单页。仔细通读,把那些纯粹是因为错别字或坐标误标而浑水摸鱼进来的无效纸片揉成团扔进垃圾桶里。教授只在桌上排开前 3 张真正命中知识死角的干货卡片。

🗣️ 5. 大脑加工组装:Generation(语境合并生成)

技术原理: 到此阶段才是终点。后端的组装流水线将过滤好的 TOP_K(比如排名前三的优质文档),与原始用户提出的疑问和固定扮演提示词(System Role Prompt)按代码规则格式全量硬编码在一起发送给生成式大语言模型本体(如 GPT-4)。最终利用大模型强悍的知识汇总提纯能力,产出最终前端 Markdown 制式的文本回答。

大白话比喻: 最后!系统才把这 3 张卡片,同时夹给聪明但从不背书的大模型。 大模型扫过卡片之后连贯通顺且不无根据瞎扯淡地回复对你说:“根据《公司差旅 v3手册》第八条规定,出差打专车必须提前获取总监级的线上审批方可操作。”